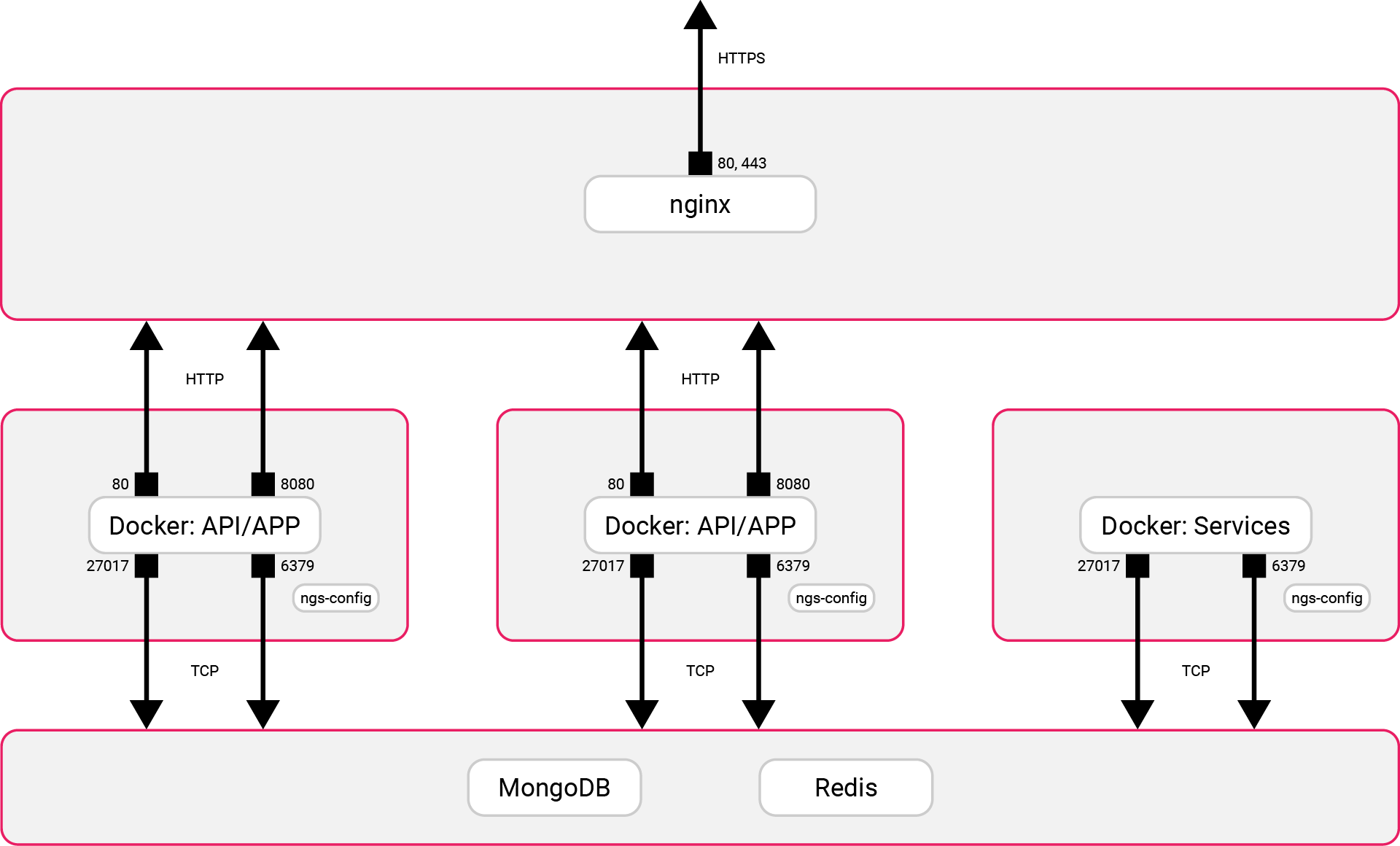

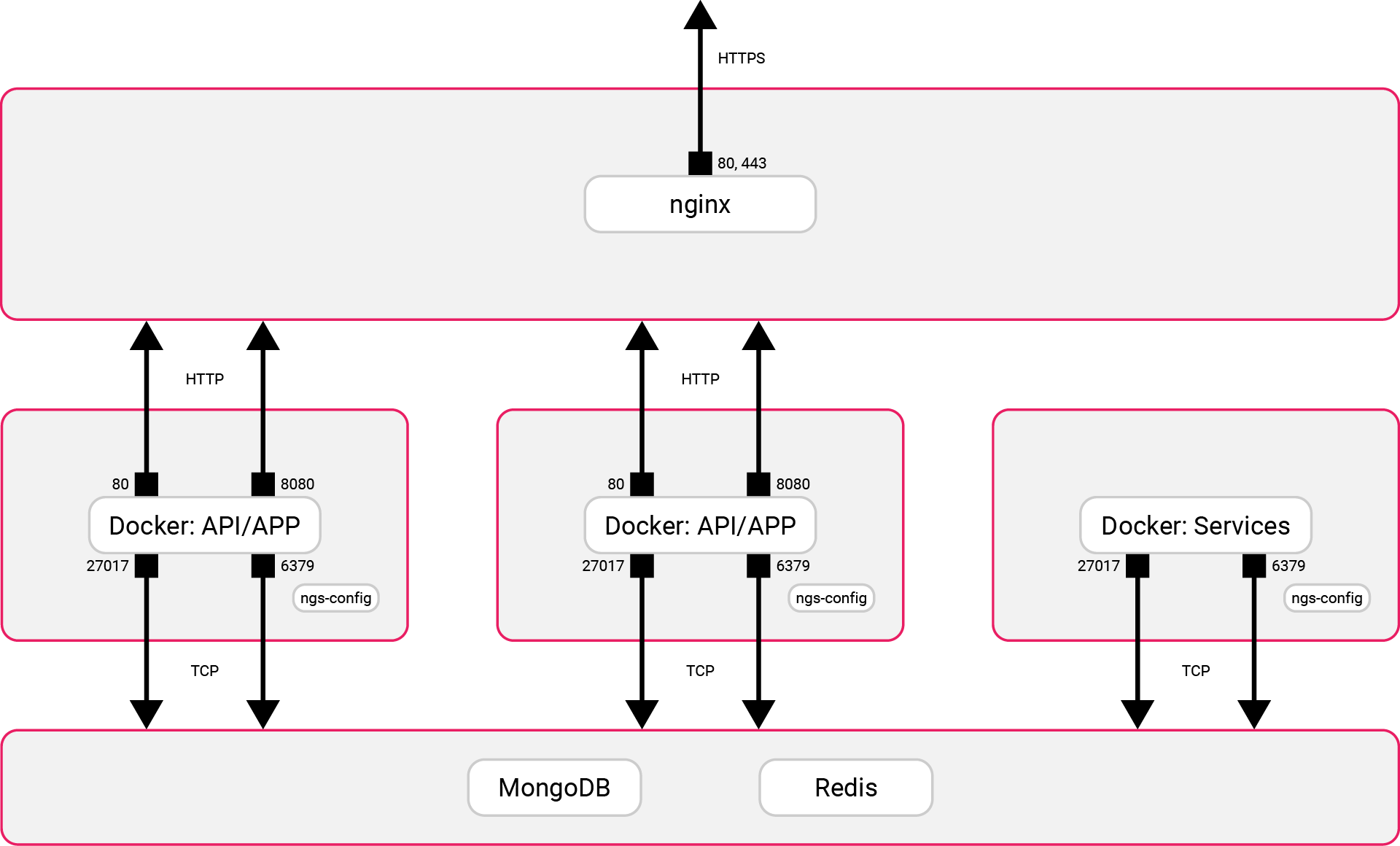

Mittels 2. App-Server und der Auslagerung der Services auf eine separate VM werden Anfragen nun gleichmäßig verteilt und die Performance gesteigert.

Mittels 2. App-Server und der Auslagerung der Services auf eine separate VM werden Anfragen nun gleichmäßig verteilt und die Performance gesteigert.

Stellen Sie sicher, dass immer die aktuellen Versionsendungen genutzt werden.

Passen Sie die iptables so an, dass jegliche Verbindungen von außerhalb zur Datenbank blockiert werden. Dieser Schritt führt dazu, dass nur die Applikation auf die MongoDB zugreifen kann und unberechtigte Zugriffe verhindert werden.

Ersetzen Sie <APP IP> durch die von der Datenbank erreichbare IP des Applikationsservers. Ersetzen Sie <DB IP> durch die von der Applikation erreichbare IP des Datenbankservers

Um Zeit und Mühe zu sparen, empfehlen wir Ihnen, entweder unsere ISO-Datei zu nutzen oder den ersten App-Server zu klonen, um die zweite VM für den App-Server zu erstellen.

Beachten Sie auch hier, dass am Ende stets die aktuellen Versionen stehen.

Passen Sie hierfür entweder die .xml an und löschen Sie alle nicht benötigten Einträge oder passen Sie die Versionen selbstständig an.

Beachten Sie hierbei, dass die URL der APP und der API auf den Loadbalancer ausgerichtet sind und nicht mehr auf den APP Server.

Beachten Sie, dass die Redis URL in redis://<IPDB>:6379 abgeändert werden muss

Beachten Sie, dass das Update-Script nun immer auf allen drei Servern ausgeführt werden muss, um sicherzustellen, dass alle Server auf dem neuesten Stand sind und keine Inkompatibilitäten auftreten.